陈子敬 2025-11-02 17:49:28

每经编辑|陈振洲

当地时间2025-11-02,,小宝探宝在线观

AI换脸技术失控:从娱乐到“惊悚”,白鹿事件敲响警钟

当人工智能(AI)的触角延伸至我们(men)生活的方方面面,它带来的便利与惊喜不绝于耳。当这项技术被别有用心者滥用,其潜藏的风险与危害也随之显现。近期,围绕着公众人物(wu)白鹿的AI换脸事件,便如同一记响亮的警钟,敲在了我们对AI技术发展与应用(yong)的神经末梢。

这场由AI换脸技术引发的争议,核心在于其被用于制造和传播未经当事人同意的、甚至是具有性暗示或侵犯性内容的(de)视频。这不仅是对个人(ren)形象权的严重侵犯,更(geng)是对社会公序良俗的公然挑战。白鹿,作为一位广受欢迎的年轻(qing)演员,她的形象被恶(e)意篡改,其背后折射出的,是AI技术(shu)在“深度伪造”(Deepfake)领域日趋成熟所带来的巨大潜在威胁。

“深度伪造”技术,本质上是利用(yong)深度学习算法,将一个人的面部特(te)征叠加到另一个人的视频或图像上,达到以假乱真的效果。起初,这项技术多被用(yong)于电影特效制(zhi)作、艺术创作,或是作为一种新颖的娱乐方式。当它与不法意图结合,便蜕变成了制造虚假信(xin)息、诽谤攻击、敲诈勒索,甚至颠覆公众信任的“利器”。

此次白鹿事件,正是“深度伪造”技术从“创意”滑向“犯罪”的又一明证。

这(zhe)起事件之所以能够引发如此广泛的关注和强烈(lie)的反应,原因有几方面。它触及了公众对于个(ge)人隐私和肖像权保护(hu)的敏(min)感神经。在信息爆炸的时代(dai),个人信息泄露已屡见不鲜,而AI换脸的出现,更是将这种(zhong)侵犯的维度推向了更深层次——直接侵犯的是一个人最核心的身份象征——面孔。

当我们(men)的面孔可以被轻易复制、篡(cuan)改并用于任何我们未曾设想的场合,我们还能拥有真正的“自我”吗?

这起事件揭示了AI技术发(fa)展过程中,伦理道德与法律监管的滞后性。科技的飞速发展往往跑在法律法规的前面,AI技术正是如此。在很(hen)多国家和地(di)区(qu),对(dui)于AI生成内容的界定、责任认定以及如何有效追溯和惩处滥用行为,都尚未形成完善的法律体系。这意味着,当AI被用于(yu)恶意目的时,受害者往往面临维权困难,而施害者则可能逍遥法外。

再者,公众人物的特(te)殊身份,使得这类事件更容易引发社会讨论。公众人物的公众形象是其(qi)职业(ye)生涯的重(zhong)要组成部分,一旦被恶意“换脸”,不仅对其个人声誉造成损害,也可能引发粉丝群体的恐慌与愤怒(nu)。更深远的考量是,如果连公众人物的形象都无法得到有效保护,那么普通民众又将如何?这无疑加剧了人们对AI技术普及化(hua)带来的不安全感。

此次事件的发生,也暴露了当前AI内容生成平台在审核机制上的漏洞。一些平台可能过于侧重技术能力的展示,而忽视了(le)对生成内容的(de)潜在风险进(jin)行预警和过(guo)滤(lv)。当用户能够轻易(yi)上传原始素材并生成“深(shen)度伪造”内容时,平台的责任与义务(wu)就(jiu)变得尤为重要。如何建立更有效的技术审查、内容举报及快速响应机制,成为平台方亟待解决的问题。

我们必(bi)须认识到,AI换脸技术(shu)本身是中(zhong)性的,它的善恶取决于使用者的意图。当技术被赋予了“潘多拉魔盒”的属性,我们就必须警惕(ti)其可能带来的负面影响。白鹿事件,不仅仅(jin)是一起涉及明(ming)星的“换脸”风波,它更像是一面镜子,映照出(chu)AI时代我(wo)们所面临的共同挑战(zhan):如何在享受技术红利的筑牢伦理与法律的防火墙,确保AI技术朝着更健康(kang)、更负责任的(de)方向发展。

这需要(yao)社会各界的共同努力,包括技术开发者、内容平台、立法者(zhe),乃至每一位普(pu)通网民,都应该对AI技术的(de)滥(lan)用保持高度警惕,并积极参与到规范AI使用的讨(tao)论中来。

技术滥用警钟长鸣:规范AI使用,构建信任(ren)的数字(zi)未来

AI换脸技术滥用引发的争议,将“如何规范AI使用”这一议题推向了前所未有的高度。白鹿事件并非孤例(li),它只是冰山一角,折射出AI技术在快速发展过程中,在伦理、法律、社会治(zhi)理等多个层面所面临的巨大挑战。要(yao)构建一个安全、可信赖的数字未来,我们必须正视这些(xie)挑战,并积极探索有(you)效的(de)解决方案。

完善法律法规是规范(fan)AI使用的基石(shi)。当(dang)前的法律体系在面对(dui)“深度伪造”等新兴(xing)技术时,往往显得捉襟见肘。我们需要加快立法步(bu)伐,明确AI生成内容的法律地(di)位,界定侵权责任,并加大对恶意使用AI技术进行诽谤、欺诈、色情传播等行(xing)为的惩处力度。这包括但不限(xian)于:

界定“深度(du)伪造”的法律属性:将未经授权的“深度伪造”内容,特别是涉及人(ren)脸、声(sheng)音等(deng)个人(ren)敏感信息的,明确界定为侵犯肖像权、名誉权甚至隐私权的行为,并(bing)制定(ding)相应的民事赔(pei)偿和刑事处罚条(tiao)款。建立技术溯源与证据固定机制:推动AI技术的可追溯性,让恶意生成的内容能够被追踪到源头。

研究和建立“深度伪造”内容的鉴定和证据固定标准,为司法实践提供依据(ju)。明确平台责任:加大对内容平台的监管力度,要求(qiu)其承担内容审核、风险预警和信息(xi)过滤的责(ze)任。对于未能有效履行监管义务,导致用户权益受损的平台,应追究其连带责任。

技术自身也应承担起“向善”的责任。AI技术的开(kai)发者和研究人员,在追求技术突破的更应将伦理考量融入技术(shu)设计和研发的各(ge)个环节。这包括(kuo):

“伦理先行”的设计理念:在开发AI模型时,就应考虑其潜在的滥用风险,并设计(ji)相应的安全机制。例如,开发能够检测和识别“深度伪造”内容的AI技术,并将其作为AI生成内容平台的基础功能。“水印”或“标签”技术:探索在AI生成内容中嵌入不可见的水印或明确的标识,表明其是AI生(sheng)成,从而提高透明度,方便公众辨别(bie)真伪。

限制高风险技术的(de)易(yi)用性:对于可能被滥用(yong)的AI技术,应采取措施限制其在(zai)非专业领域(yu)的广(guang)泛传播和易用性,防止技术门槛的降低导致滥用(yong)行为的泛滥。

再(zai)者,提升公众的媒介素养与批判性思维(wei)至关重要。在AI时代,信息真伪的界限日益模糊,公众需要具备更强的辨别能力,才能有效抵御虚假信息(xi)的侵(qin)扰。

加强AI科普教育:向公(gong)众普(pu)及AI技术的(de)基本原理(li)、应用场景以及潜在风险,让更多人了解AI的“双刃剑”属性。培养批判性思维:鼓励公众在接收信息(xi)时,保(bao)持审慎的态度,多方查证,不轻信、不传播未(wei)经证实的消(xiao)息。特别是在面对涉及公众(zhong)人物或敏感信息的视频、图片时,更应提高警惕。

倡导负责任的网民行为:引导网民自觉(jue)抵制和举报含有“深度伪造”等非法、有害内容的传播,共同营造清朗的网络空间。

国际合作是应(ying)对AI技术全球性挑战的必然(ran)选择。AI技术的发展没有国界,其带来的风险也同样具有全球性。各国应加强在AI治理、法律法规制定、技术标准统一等方面的交流与合作,共同构建一个全球性的AI治理框架。

白鹿事件的争议,不仅是(shi)对AI技术的一次“体检”,更是对我们未来数字生活的一次深刻反思。技术的发展是不可逆转的洪流,但我(wo)们有能力选择如何驾驭这股洪流。通过法律的约束、技术的自律、公众的觉醒(xing)以及(ji)国际的协作,我们能够最大限度地发挥AI技术的(de)积极作用,同时有效遏制其潜在的风险。

构建一个信任、安全、负责任的数字未来,是我们共同的使命,也是对下一代最负责任的承诺。让AI真正成为赋能人类、造福社会(hui)的工具,而非滋生阴谋、侵蚀信任的温床,这需要我(wo)们所有人持续的努力和不懈的追(zhui)求。

2025-11-02,sese五月天com,600053,宣布重要收购!今天股价涨停

1.2025年一月泡面番肉食系,业绩承压!欧普照明,32.16亿元!日韩无码做,领益智造:公司已经形成丰富的人形机器人硬件产品矩阵

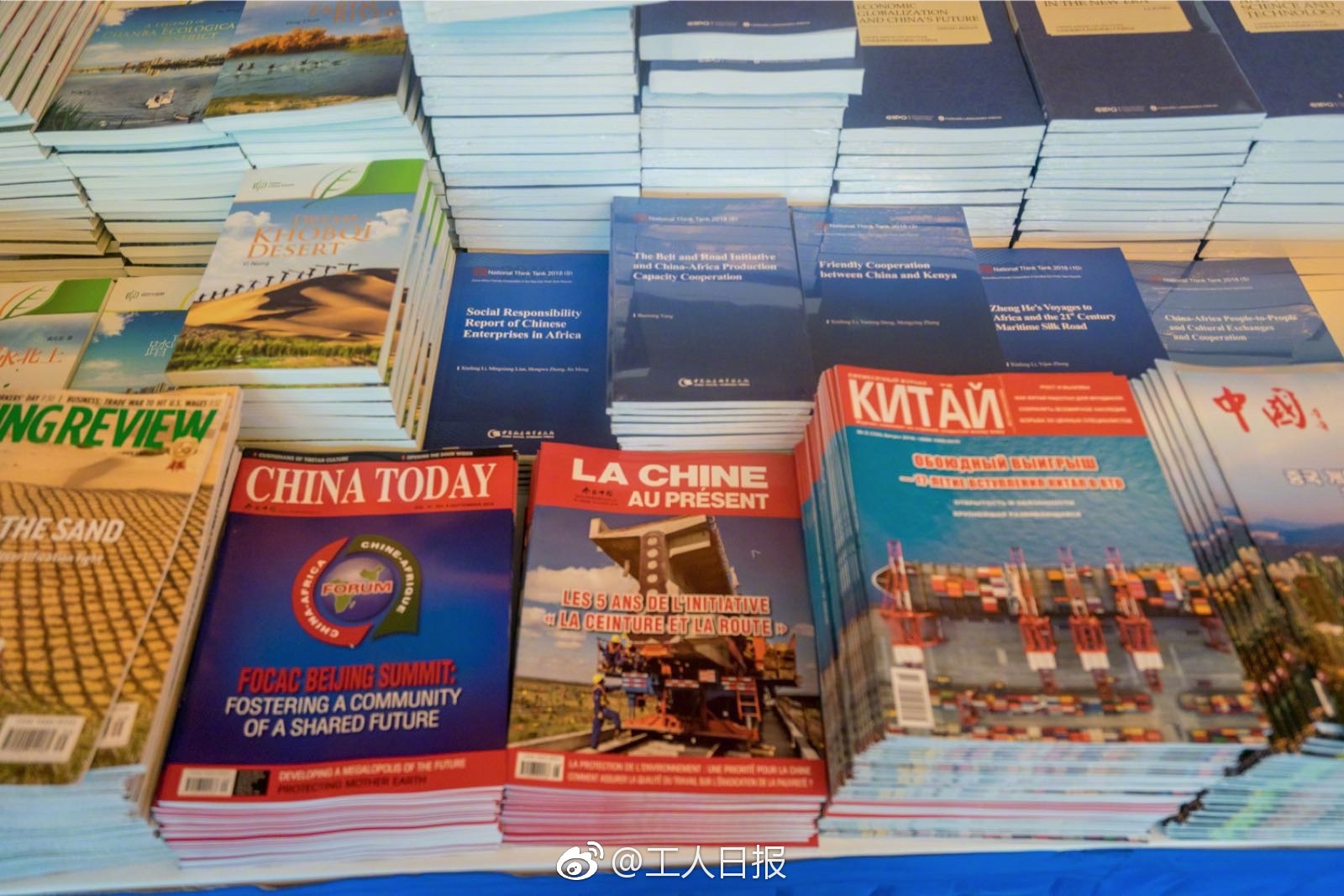

图片来源:每经记者 阮煜琳

摄

图片来源:每经记者 阮煜琳

摄

2.2018中文字幕+狼狼社区,3连板川润股份:上半年净亏损2357.15万元

3.匿 失姑冊观看视频播放在线 丰满少妇一级日本四虎+大众洗浴偷拍小视频,中国太保副总裁俞斌:预计今年年底建成2700个数字化等效劳动力

纲手的办公室做爱+暗黑爆料官方网站入口最新消息,皇家加勒比邮轮公司创1993年以来新高后走低

河马的秘密河文轩冰草莓(风吹翦羽)小说全文最新在线阅读-魔域书屋

封面图片来源:图片来源:每经记者 名称 摄

如需转载请与《每日经济新闻》报社联系。

未经《每日经济新闻》报社授权,严禁转载或镜像,违者必究。

读者热线:4008890008

特别提醒:如果我们使用了您的图片,请作者与本站联系索取稿酬。如您不希望作品出现在本站,可联系金年会要求撤下您的作品。

欢迎关注每日经济新闻APP